如何用navicat将csv快速导入数据库打开Navicat ,在我们要到处的数据上面右击鼠标,然后弹出的快捷菜单上点击“转储SQL 文件”,在再次弹出的子菜单项中选择第一个“数据跟结构”

高性能计算GBDT的原理是什么?

从原理上来说,GBDT 和 SVM 哪个更强?为什么

GBDT 全称为 Gradient Boosting Decision Tree。是一种基于决策树(decision tree)实现的分类回归算法。GBDT 有两部分组成: gradient boosting, decision tree。 支持向量机(support vector machine)是一种分类算法,通过寻求结构化风险最小来提高学习机泛化能力,实现经验风险和置信范围的最小化,从而达到在统计样本量较少的情况下,亦能获得良好统计规律的目的。 这两个算法关键看应用场景,主要是特征数量、训练过程和可解释性有区别。SVM 能够训练大量特征,不用考虑特征离散化或者分段,非线性映射可以很好的分gbdt算法是什么?

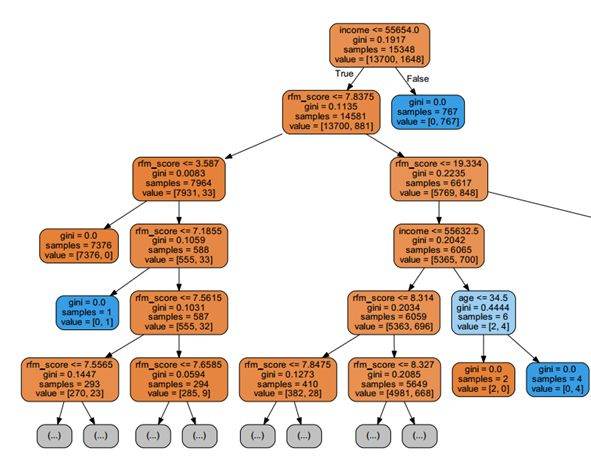

如下图:

在建立GBDT对象并作fit之后,可以使用如下代码获得要的规则代码:

dot_data = tree。export_graphviz(model_tree, out_file=None,

max_depth=5, feature_names=names_list, filled=True, rounded=True) # 将决策树规则生成dot对象。

模型最终可以描述为:

Fm(x)=∑m=1MT(x;θm)Fm(x)=∑m=1MT(x;θm)

模型一共训练M轮,每轮产生一个弱分类器T(x;θm)T(x;θm)。弱分类器的损失函数

θ^m=argminθm∑i=1NL(yi,Fm−1(xi)+T(xi;θm))θ^m=argminθm∑i=1NL(yi,Fm−1(xi)+T(xi;θm))

Fm−1(x)Fm−1(x)为当前的模型,gbdt通过经验风险极小化来确定下一个弱分类器的参数。具体到损失函数本身的选择也就是L的选择,有平方损失函数,0-1损失函数,对数损失函数等等。如果我们选择平方损失函数,那么这个差值其实就是我们平常所说的残差。

相关文章

- 详细阅读

-

excel表格,一组数间隔不等,如何在改详细阅读

excel 里怎么做可以时下拉的数字间隔自由调整,比如我要一列10、20、30...这样间隔为十的一列数据方法一:A1输入10,A2输入20,选中两者,移动光标到A2右下方,待光标变为黑色十字后下

- 详细阅读

-

急!急!急!求问大佬,将已有数据按条件进详细阅读

EXCEL请问怎么把EXCEL里面的表格筛选后的东西自动生成一个新的EXCEL表格1、计算机打开Excel并准备要过滤的表单。2、选择过滤器目标列,然后按过滤器快捷方式。3、输入快捷键

-

WPSExcel数据制表后在会总行前插入详细阅读

excel把一个表格中的数据复制到另一个表格为什么是一片空白表格中的数据设置保护1、如图,这是设置了保护的数据,是不可以进行更改编辑和复制粘贴的。2、点击工具栏中的审阅,然

-

表格中多列数据相同,顺序不同,如何快详细阅读

表格中多列数据相同,顺序不同,如何快速找出顺序数值完全相同的列?以C列为辅助列,在C1单元格输入以下公式,然后向下填充公式 =IF(VLOOKUP(A1,D:E,2,0)=B1,"","不同") 得到A1如果在

-

A列是日期,B列是数据,当A列月份为当详细阅读

如何将excel中A列是数字月份,B列是数字日期,转换到C列变日期格式假设A1是月份,B1是日期,那么 在C列输入公式 =DATE(2012,A1,B1) 年份设置成2012 或者用公式 =DATE(YEAR(TODAY())

-

数据透视 加入数据模型 如何添加计详细阅读

如何在数据透视表中插入计算字段选中透视表,数据透视表工具--选项--工具--公式--计算字段,在插入计算字段对话框中: “名称”中输入自定义名称; “公式”中输入计算式(可以在下面的“字段

-

在两个表格中多条件相互查找相同、详细阅读

如何比对两个excel表格中的不同的数据方法1:使用Excel的视图并排查看功能打开需要对比的工作簿。你可以通过打开Excel,点击文件,然后点击打开,并从弹出的菜单中选择两个工作簿进

-

IMS语音专线需要在哪些地方做数据?详细阅读

中国移动政企产品如何分类一、互联网专线 互联网专线接入业务是指为客户提供链路连接至互联网(中国移动为CMNET),实现方便快捷的高速互联网上网服务,客户可自由选择各种 带宽和